rueki

Week12. Research Directions 본문

1. Unsupervised Learning

Supervised learning은 학습방법 중에 지금까지 학습이 제일 잘 되는 방법이지만, 그에 따라 레이블이 된 데이터가 많이

필요하기에 레이블이 안 되있는 경우 적용할 수 없으며 레이블링 하는 데에도 비용이 많이 든다.

이를 해결해보고자 Semi-supervised learning과 Unsupervised learning이 나왔다.

- Semi-supervised

레이블링이 되어있지 않은 데이터에 대해서 레이블링을 해보자라는 개념에서 나온 것으로서, 임의의 데이터가 라벨링 된 데이터와 유사하다면 같은 레이블로 가정하는 것이다. 다양한 방법론 중에 하나인 Noisy-student를 설명한다.

1) 레이블된 이미지로 teacher 모델을 학습

2) 레이블되지 않은 이미지에 pseudo label을 생성하기 위해 학습된 teacher model을 사용

3) 레이블된 이미지와 pseudo label된 이미지를 이용해서 student model 학습.

4) student model을 teacher model로 사용하여 위의 과정 반복

student 모델을 학습할 때 noise를 추가하는데 모델에 noise를 넣는 방법(ex. dropout), 인풋데이터에 noise를 넣는 방법(data augementation)을 사용해서 noisy-student라는 이름이 붙여졌다.

- Deep unsupervised learning

레이블이 되어있지 않은 데이터를 사용함으로서 데이터 셋 안에서 유사한 특징을 가지는 데이터끼리 비슷한 클래스를 가진다고 가정을 하게된다.

딥러닝을 이용한 방법론에서 multi-headed networks를 소개한다.

각 task마다 head를 달아서 학습을 하는데, 메인 네트워크에서는 학습되는 가중치가 공유되기 때문에 task1에서 이미지 생성, 단어 예측 등과 같은 것들을 충분히 성능이 나오게 된다면, task2에서는 적은 데이터에서 지도학습으로 학습이 가능해지게 된다고 한다.

컴퓨터 비전에서 self-supervised learning 개념으로 나온 contrastive learning이 되게 주목받았었는데 이에 대해서도 설명을 한다. Constrative learning의 기본 concept은 이미지들 중에서 비슷한 이미지는 positive pair로 보고 그 외는 negative pair로 인지하여, 두 set를 서로 점점 멀리 떨어지게하는 컨셉이다. 여기서 positive pair 구성은 하나의 이미지를 augmentation 적용하여 서로 다른 이미지로 쌍을 구성하게 된다.

3. Reinforcement Learning

강화학습은 Agent가 임의의 policy에 따른 reward 주며 state를 update해가면서 목표치를 달성해가는 학습방법이다.

이전의 학습방법과 달리, 매 step마다 state가 달라지기 때문에 순간순간의 값들을 잘 파악해서 올바르게 학습을 이끌어 나가야한다.

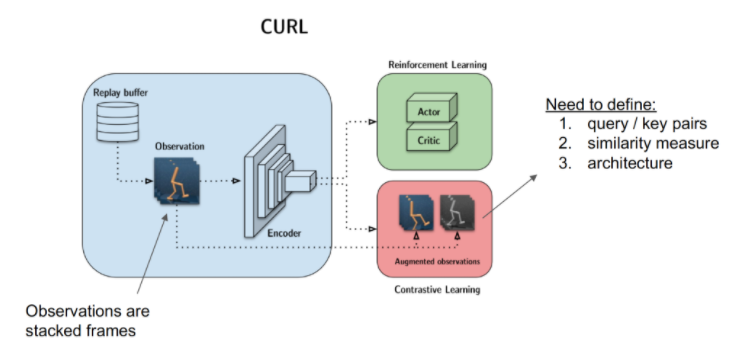

unsupervised learning과 접목한 모델이 CURL이라고 있는데 Contrastive learning Reinforcement Learning의 약자이다.

buffer에서 이전의 관측치들이 저장되어 있는데 이를 불러와서 네트워크에 넣고 두 개의 헤드(강화학습, Constrative learning)를 통해서 각 task를 다루어 update하는 방법이다.

'MLOPS > full stack deep learning review' 카테고리의 다른 글

| Week11 Deployment & Monitoring part2 (0) | 2021.11.21 |

|---|---|

| Week11 Deployment & Monitoring part1 (0) | 2021.11.18 |

| Week 8. Data Management (0) | 2021.10.28 |

| Week 7. Troubleshooting Deep Neural Networks (0) | 2021.10.21 |

| week6. Infrastructure & Tooling (0) | 2021.10.11 |